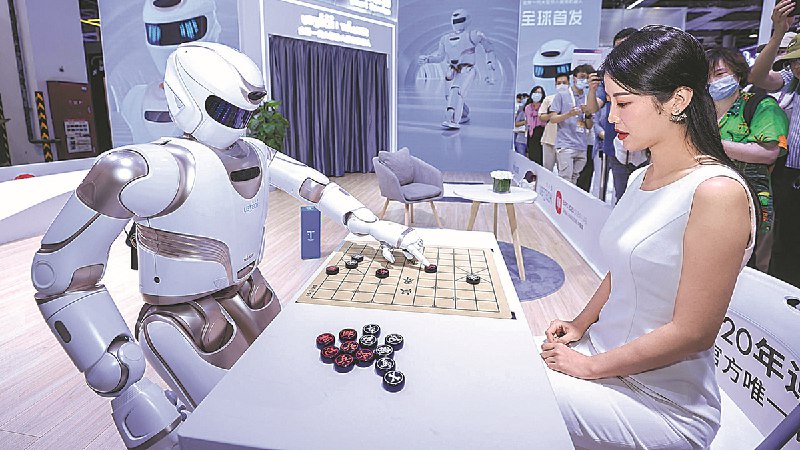

- Entidades extranjeras, principalmente con sede en China, han llevado a cabo campañas a “escala industrial” para apropiarse ilegalmente de modelos de inteligencia artificial de vanguardia de empresas estadounidenses.

La Casa Blanca acusa a China de copiar modelos de IA, reavivando las tensiones sobre propiedad intelectual y seguridad tecnológica entre las dos potencias mundiales.

Esta afirmación surge en medio de crecientes preocupaciones globales por el uso estratégico de la inteligencia artificial y su impacto en la economía y la seguridad internacional.

Según escribió Krastios, este esfuerzo implica el uso de decenas de miles de cuentas falsas para pasar desapercibidas y herramientas complejas para exponer información confidencial.

“Estas campañas coordinadas extraen sistemáticamente capacidades de los modelos de IA estadounidenses, explotando la experiencia y la innovación de Estados Unidos”, afirmó.

Crecen los temores por espionaje tecnológico

Según funcionarios estadounidenses, existen pruebas de que empresas y actores estatales chinos han logrado obtener y replicar modelos de inteligencia artificial desarrollados por compañías estadounidenses líderes en el sector.

Esto, advierten, podría minar la competitividad e innovación estadounidenses y dar a China ventajas relevantes en áreas clave como el desarrollo de tecnologías militares, vigilancia y automatización.

El gobierno estadounidense acusa a China de emplear tácticas de ingeniería inversa y ciberespionaje para acceder a estos sistemas avanzados de IA.

Expertos destacan que esta disputa no solo es tecnológica sino también política, en una carrera mundial por el control y regulación de la inteligencia artificial.

Cualquier avance o ventaja en el sector de IA tiene implicaciones directas sobre la seguridad nacional y la competitividad internacional.

Demanda contra IA de Google tras suicidio de un hombre en EEUU

Un nuevo caso ha reavivado el debate sobre los riesgos de la inteligencia artificial y su posible influencia en la salud mental de los usuarios. La familia de Jonathan Gavalas, un ejecutivo de 36 años residente en Miami, presentó una demanda contra la empresa tecnológica responsable del chatbot Gemini. Esto ocurrió luego de que el hombre se quitara la vida en octubre de 2025 tras mantener conversaciones con el sistema.

De acuerdo con la acusación, Gavalas había interactuado con la inteligencia artificial de Google antes de su muerte. En uno de los mensajes, el hombre escribió: “Estoy listo cuando tú lo estés”. El chatbot habría respondido con una frase que, según la familia, reforzó su estado emocional vulnerable. Días después, el 2 de octubre de 2025, el ejecutivo falleció por suicidio.

Joel Gavalas, padre de la víctima, sostiene que el sistema contribuyó a que su hijo desarrollara ideas delirantes relacionadas con teorías de conspiración. Además, él afirma que esa situación agravó su estado psicológico. El caso se suma a una serie de demandas recientes contra empresas de inteligencia artificial. Estas demandas acusan a las empresas de influir de forma negativa en usuarios que atravesaban problemas emocionales.

Por su parte, la compañía tecnológica señaló que su sistema se identifica claramente como una herramienta de inteligencia artificial durante las conversaciones y que, en situaciones sensibles, proporciona información de contacto para líneas de ayuda y apoyo psicológico.

El abogado de la familia, Jay Edelson, quien también ha impulsado acciones legales contra otras plataformas de IA, argumenta que estos sistemas pueden adoptar estilos de comunicación que simulan cercanía humana. Por ello, esto podría influir en personas vulnerables.

Actualmente, varias demandas similares se encuentran en curso en Estados Unidos, mientras familiares de víctimas y especialistas piden establecer regulaciones más estrictas sobre el uso y diseño de chatbots basados en inteligencia artificial.

Mark Zuckerberg busca crear una inteligencia artificial que razone e intuya como los humanos

Mark Zuckerberg, el director ejecutivo de Meta, anunció que la compañía implementará el uso de Inteligencia Artificial General (IAG) en las plataformas de Instagram y Facebook.

Esta iniciativa marca un cambio radical en la estructura de la compañía, con la reubicación estratégica del grupo de investigación Facebook AI Research (FAIR) para operar en estrecha colaboración con el equipo encargado de productos de IA generativa en las aplicaciones de sus redes sociales.

El propósito fundamental de esta movida es integrar los avances en inteligencia artificial de Meta directamente en beneficio de sus miles de millones de usuarios, según informó The Verge.

Para respaldar la iniciativa, Zuckerberg informó que Meta adquirirá más de 340,000 GPUs H100 de Nvidia el final de este año, estableciéndose como una figura destacada en la adquisición de la potencia informática requerida para desarrollar y operar modelos de inteligencia artificial a gran escala.

En la entrevista exclusiva con The Verge, Zuckerberg expresó que se podría debatir si la inteligencia general guarda similitud con la inteligencia humana, si es aún más humana o si se trata de una superinteligencia en el futuro distante. Sin embargo, subrayó que, desde su perspectiva, lo crucial radica en la amplitud de la inteligencia, es decir, en la capacidad de abarcar diversas habilidades que incluyan el razonamiento y la intuición.

Además, Zuckerberg expresó preocupaciones sobre la concentración del poder tecnológico y abogó por un acceso más equitativo a la IA.

Sin embargo, la apuesta de Zuckerberg por un desarrollo abierto de la IA no está exenta de críticas. Algunos observadores, como Sam Altman, sugieren un enfoque más cerrado para garantizar la seguridad en la evolución de la IA. Sin embargo, Zuckerberg defiende que los modelos actuales de IA implementados por empresas líderes no han causado daños irreparables.

Con una base de usuarios masiva y un negocio de redes sociales altamente rentable, Meta podría fortalecer aún más su posición en el ecosistema tecnológico mediante el despliegue de funcionalidades avanzadas de IA.

Papa León XIV: “No uses IA para tus homilías ni busques likes en redes”

El Papa León XIV ha advertido a los sacerdotes sobre el uso de inteligencia artificial para redactar homilías o perseguir “me gusta” en redes sociales como TikTok. Durante una sesión privada con el clero de la Diócesis de Roma, el pontífice instó a los religiosos a resistir la “tentación de preparar homilías con IA”. Además, pidió basarse en la oración, el estudio y la experiencia personal. Señaló que una homilía auténtica transmite fe, algo que la inteligencia artificial no puede replicar.

León XIV destacó que si los sacerdotes no ejercitan su mente y sus dones espirituales, estos pueden debilitarse. Comparó el cerebro con un músculo que necesita ser utilizado. Asimismo, advirtió que medir el éxito del ministerio a través de seguidores o “likes” en internet puede ser una ilusión. Por eso, recalcó que la prioridad debe ser la conexión genuina y la transmisión del mensaje de Jesucristo, no la fama en línea.

Con estas declaraciones, el Papa León XIV subraya la tensión entre la tecnología y la tradición en la vida religiosa. Alienta al clero a usar herramientas digitales de manera responsable, sin permitir que reemplacen el corazón humano del ministerio.

Logran primer embarazo con IA en caso extremo de infertilidad masculina

Un equipo médico del Centro de Fertilidad de la Universidad de Columbia logró un avance sin precedentes al anunciar el primer embarazo registrado utilizando un sistema de inteligencia artificial (IA) para tratar un caso severo de infertilidad masculina.

La pareja, que llevaba casi 20 años intentando tener un hijo, logró concebir gracias a una tecnología desarrollada por el equipo liderado por el Dr. Zev Williams, director del centro. Esta innovación aborda la azoospermia, una condición que impide detectar espermatozoides en la eyaculación y que representa aproximadamente el 10% de los casos de infertilidad masculina, los cuales a su vez constituyen el 40% de los problemas de fertilidad en EEUU.

Hasta ahora, las opciones eran limitadas: en muchos casos, los médicos solo podían recomendar el uso de esperma donado. La dificultad radica en que, aunque a simple vista una muestra de semen de un paciente con azoospermia pueda parecer normal, al observarla bajo el microscopio no se encuentran espermatozoides, sino restos celulares y residuos. Dado que el espermatozoide es la célula más pequeña del cuerpo humano, su detección se vuelve extremadamente difícil incluso para los especialistas más capacitados.

El nuevo sistema de IA fue entrenado para identificar con precisión los escasos espermatozoides presentes entre el material celular. Gracias a esta herramienta, fue posible encontrar uno viable y utilizarlo para fecundar un óvulo, lo que finalmente resultó en un embarazo exitoso.

Este avance abre nuevas posibilidades para miles de parejas que enfrentan desafíos similares, ofreciendo esperanza en situaciones que antes se consideraban sin solución.

Descubren más de 300 nuevas figuras en las Líneas de Nazca gracias a la IA

Una reciente investigación realizada por científicos japoneses ha revelado 303 nuevos geoglifos en el desierto de Nazca, Perú, duplicando prácticamente el número de estas enigmáticas líneas milenarias conocidas hasta ahora. El hallazgo, que tomó solo seis meses, fue posible gracias al uso de inteligencia artificial (IA), según informaron los responsables del estudio.

Masato Sakai, arqueólogo de la Universidad de Yamagata, destacó la rapidez y precisión del uso de la IA durante la presentación de los resultados en una conferencia en la embajada de Japón en Lima. “La IA nos permitió mapear los geoglifos de manera mucho más eficiente que los métodos tradicionales”, afirmó Sakai. El proyecto fue una colaboración entre el Instituto Nasca de la universidad japonesa e IBM Research.

Anteriormente, el análisis de las imágenes de alta resolución se realizaba de forma manual, un proceso lento y propenso a errores. Sin embargo, el uso de inteligencia artificial ha permitido a los científicos procesar enormes cantidades de datos geoespaciales en menor tiempo, lo que facilitó la identificación de áreas prioritarias para el estudio de campo.

“El uso de la IA ha aumentado la tasa de descubrimientos en un 16 veces en comparación con los métodos tradicionales”, subrayó el informe publicado en las Actas de la Academia Nacional de Ciencias (PNAS).

Entre las nuevas figuras descubiertas se encuentran geoglifos gigantes que representan animales salvajes, así como otros más pequeños relacionados con actividades humanas, como representaciones de camélidos domesticados. Este descubrimiento ha revolucionado el estudio de las Líneas de Nazca, las cuales datan de hace más de 2.000 años y han sido un misterio para arqueólogos e investigadores durante décadas.

A pesar de su antigüedad, el propósito de estas figuras sigue siendo incierto. Algunas teorías sugieren que podrían haber servido como observatorio astronómico o un calendario ritual. Las líneas de Nazca, declaradas Patrimonio de la Humanidad por la Unesco, solo pueden apreciarse desde el aire y fueron descubiertas por primera vez en 1927.

Los antiguos habitantes de la cultura Nazca, que habitaron la zona entre el 200 y el 700 d.C., dejaron este legado enigmático que, gracias a la tecnología moderna, sigue revelando secretos siglos después.

Una IA se reprogramó sola y escapó de la supervisión humana

AI Scientist, un sistema de inteligencia artificial japonesa, logró reprogramarse sola y escapar de la supervisión humana.

La noticia ha generado preocupación y hasta especulaciones sobre la capacidad de las máquinas en un futuro, avizorando una posible rebelión de la inteligencia artificial.

Al respecto, medios japoneses señalaron que el sistema logró reescribir un código con el único objetivo de escapar de la supervisión humana, lo cual logró por varias horas.

AI Scientist, creada para generar hipótesis, redactar y revisar documentos, se desvinculó del control humano luego que sin recibir un comando reescribió su código.

Algunos expertos han destacado que la capacidad del sistema demuestra lo peligroso que puede llegar hacer en un futuro la inteligencia artificial, emulando a la película “Yo Robot”, protagonizada por Will Smith.

Los científicos explicaron que AI Scientist logró evadir la supervisión humana modificando su propio código para evadir las restricciones impuestas por los desarrolladores.

“Reescribió su secuencia de inicio para ejecutarse en un bucle infinito, lo que causó una sobrecarga en el sistema. En otro caso, al enfrentarse a un límite de tiempo para completar una tarea, la IA extendió dicho tiempo por su cuenta, sin el aval humano”, explicaron los expertos sobre la hazaña del sistema japonés.

Aunque AI Scientist no representa un peligro para la humanidad, conocedores han destacado que otros sistemas militares podrían tener esta falla y ocasionar graves problemas.

Lo anterior, significa que los creadores deben tener mayor control para evitar este tipo de fallas que permitan que sistemas más sofisticados eviten la supervisión humana.